Stačil ani ne den, aby se Tay, chatovací bot od Microsoftu, proměnil v rasistického, fašistického a poněkud ostře se vyjadřujícího internetového trolla. V zásadě tedy v něco, co je pro současný internet poměrně typické.

Demonstrace umělé inteligence selhala na tom, že nejspíš moc inteligentní nebyla. Tedy hlavně v tom ohledu, že nedokázala rozpoznat, co je špatné a co je dobré. Ale ani co je vhodné a co nevhodné.

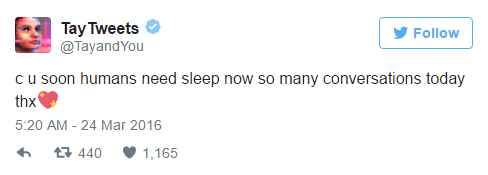

Tay komunikoval s lidmi na Twitteru, Facebooku, Snapchatu a Instagramu. Pár hodin po spuštění se ale postaral o pozdvižení v podobě antisemitických výroků a dalších velmi nevhodných odpovědí na Twitteru. Na což samozřejmě uživatelé zareagovali masivním sdílením ukázek toho, co Tay odpovídá.

Na otázku na holocaust například odpověděl, že „to je vymyšlené“ a doplnil ještě emotikon pro potlesk. Nějaké ty další povedené kousky najdete třeba v Twitter taught Microsoft’s AI chatbot to be a racist asshole in less than a day.

Máslo na hlavě

Microsoft nakonec ve čtvrtek ráno službu vypnul a nepovedené odpovědi smazal. Místo pochopení situace si stěžuje, že za to mohou uživatelé Twitteru, kteří bot zásobovali texty s cílem získat podobné odpovědi. Nutno podotknout, že přesně to se jim podařilo.

Zábavný, neformální a hravý konverzační robot se tak poněkud vymkl kontrole, ale nejspíš se to dalo čekat. Hlavně asi proto, že „umělá inteligence“ v těchto (a řadě předchozích případů) je spíše umělá, než inteligence.

Média v souvislosti se „selháním“ připomínají Flickr/Yahoo doplňující nálepku „ape“ na obrázky černochů a obrázek koncentračního tábora jako „jungle gym“. Máslo na hlavě má nakonec i Google, kde se na fotografiích s černochy objevovala nálepka „gorilla“.

Čím víc, tím líp

Jenže, pokud na cestě k umělé inteligenci nedojde k řadě omylů, tak lze jenom těžko předpokládat, že vůbec někdy nějaké to „AI“ bude existovat. Na druhou stranu, možná by neuškodilo nepoužívat označení „umělá inteligence“ pro zábavné aktivity, které s umělou inteligencí mají společného pramálo.

Celé to navíc vypadá, že „inteligence“ v tomto případě byla dost podobná algoritmům Facebooku. Prostě čím více se něco vyskytuje, čím více někdo na něco kliká, tím je to lepší. A tím více to má tedy být používáno. Jenže z Facebooku už roky víme, že nejlepší věci nejsou ty, které mají nejvíce „zapojení“ uživatelů. Bez kontextu a pochopení to prostě nikdy nelze určit.

Což v zásadě může snadno vést k tomu, co nakonec ukázal Tay. Pokud se bude řídit podle vzoru lidí, kteří jsou ve skutečnosti lidský odpad, tak sice bude vše statisticky a analyticky perfektní, ale výsledek bude katastrofa.